El sector salud se encuentra en una encrucijada de transformación tecnológica, donde la inteligencia artificial promete mejoras sin precedentes en precisión diagnóstica, eficiencia operativa y resultados para pacientes. Sin embargo, investigaciones recientes revelan una paradoja inquietante: los mismos sistemas de IA que impulsan avances médicos podrían estar erosionando silenciosamente las habilidades humanas que fueron diseñados para potenciar.

Estudios recientes en gastroenterología demuestran que el uso prolongado de sistemas de colonoscopia asistidos por IA se correlaciona con tasas decrecientes de detección de pólipos entre profesionales humanos cuando la tecnología no está disponible. Este fenómeno, denominado 'complacencia por automatización', ocurre cuando los profesionales médicos ceden gradualmente autoridad decisoria a los sistemas de IA, resultando en atrofia de habilidades por desuso.

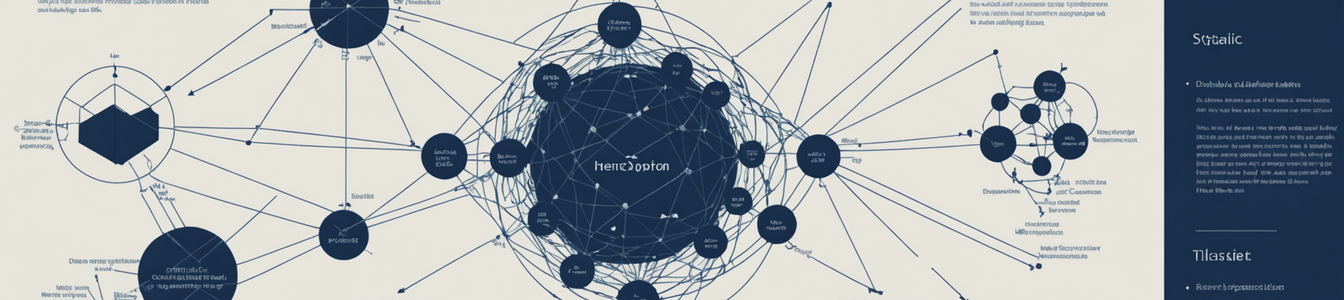

Desde una perspectiva de ciberseguridad, esta dependencia crea vulnerabilidades sistémicas. Las organizaciones de salud deben ahora considerar:

- Requisitos de redundancia: Mantener expertise humano como respaldo ante fallas o ciberataques a sistemas de IA

- Protocolos de validación: Asegurar que los resultados de IA puedan ser evaluados adecuadamente por profesionales humanos

- Continuidad formativa: Desarrollar programas de educación médica que equilibren uso de IA con retención de habilidades básicas

El desafío se intensifica conforme la IA en salud se vuelve más sofisticada. Los sistemas de IA generativa, aunque mejoran la eficiencia operativa hasta en 46% en algunos sectores (como se observa en aplicaciones bancarias paralelas), presentan riesgos particulares cuando sus resultados probabilísticos se interpretan como conclusiones médicas definitivas.

Los profesionales de ciberseguridad deben colaborar con instituciones médicas para:

- Implementar sistemas de verificación humano-en-el-loop

- Desarrollar trazas de auditoría completas para procesos decisorios de IA

- Establecer protocolos para evaluaciones periódicas de habilidades del personal médico

- Crear procedimientos seguros de contingencia para fallas en sistemas de IA

Con la creciente digitalización de la salud, las implicaciones de ciberseguridad de esta erosión de habilidades van más allá de la competencia médica. La excesiva dependencia de sistemas de IA crea puntos únicos de falla que podrían ser explotados por actores maliciosos o llevar a fallas catastróficas durante interrupciones del sistema. El sector salud debe navegar esta paradoja desarrollando marcos que aprovechen los beneficios de la IA mientras protegen el expertise humano que sigue siendo esencial para validación de sistemas, gestión de crisis y supervisión ética.

Comentarios 0

Comentando como:

¡Únete a la conversación!

Sé el primero en compartir tu opinión sobre este artículo.

¡Inicia la conversación!

Sé el primero en comentar este artículo.